Tehisintellektist (TI) räägitakse kui suurest võimalusest, aga ka sellest, millised on selle rakendamise järelmid. Näiteks sisaldavad tehisintellekti abil koostatud materjalid tunduvalt rohkem sõnu kui ilma TI-ta koostatud materjalid. Procter & Gamble’i eksperimentaalsest uuringust selgus, et nii individuaalselt kui ka grupis tooteinnovatsiooniga seotud ülesannet täites oli osalejate koostatud materjalis sõnade arv TI kasutamise korral kaks korda suurem kui ilma TI-ta.1 Samal ajal on tõusnud teemaks, et tehisintellektiga seotud toimingud on ressursimahukad ja selle illustreerimiseks kasutatakse piltlikku väljendit, kus ressursi mahtu võrreldakse vee kuluga. Näiteks ilmus Washington Postis analüüs, mis näitab, et keskmiselt kulub ühe sajasõnalise ChatGPT vastuse jaoks ligikaudu 519 ml jahutus- ja elektritootmise vett, mis varieerub sõltuvalt andmekeskuse jahutusviisist ja kliimast.2

Sõnade ja teiste märkide kasutamise õigustuseks tuuakse vahel välja, et neid vajatakse sõnumi inimlikustamiseks ehk antropomorfiseerimiseks. Antropomorfiseerimine põhineb inimeste loomupärasel kalduvusel „inimlikustada“ maailma enda ümber, pakkudes sotsiaalseid ja kognitiivseid raamistikke tundmatute või keeruliste süsteemide mõistmiseks.3 Nende kahe tugeva argumendi – ühelt poolt looduskeskkonna säästmine ja teiselt poolt inimese loomupärane soodumus – põhjal saab küsida, kas ja missugune mõju on tajutava materjali inimlikustamisel? Kui see on tähtis, siis tuleb leppida mõjuga looduskeskkonnale. Kuid võib ka ilmneda, et saame hakkama vähema hulga inimlikustamiseks vajalike märkidega. Selle artikli eesmärk on näidata, kas ja mil määral mõjutab tehisintellektiga suhtlemisel inimlikustamine sõnumi sisu tajumist.

TI-süsteemide inimlikustamine

Tehisintellekti tõhusat ja laialdast kasutamist takistab tehnoloogilistele rakendustele suunatud vastumeelsus. Üheks põhiprobleemiks on inimeste kalduvus usaldada rohkem inimeste tehtud otsuseid kui masinate omi, isegi kui masinad on objektiivselt täpsemad.4 Seda nähtust nimetatakse algoritmi vastumeelsuseks, mida iseloomustavad inimeste eelarvamused ja ootused, et algoritmid peaksid olema veatud. Seejuures kaob usaldus kiirelt, kui algoritm teeb vea, samal ajal kui inimeste vigu aktsepteeritakse mõistvamalt.5 Kuigi algoritmid parandavad prognooside täpsust ja toetavad otsustusprotsesse, loobuvad kasutajad sageli nendest kohe pärast esimese vea märkamist.5 Samuti takistab vastumeelsus algoritmile hübriidlahenduste kasutuselevõttu, kus inimesed ja algoritmid töötaksid koos, et saavutada parim võimalik tulemus. Usalduse puudumise tõttu jäävad tehisintellekti võimalused sageli rakendamata.6

Hääl, empaatia ja emotsioonide väljendamine seostuvad tehisintellekti kasutamisel kõrgema kasutajate kaasatuse ja rahuloluga.7,8 Antropomorfiseerimine loob usaldusväärsust ja intuitiivsust, mis parendavad kasutajakogemust ning soodustavad sujuvamaid töövooge, võimaldades kasutajatel TI-süsteemidega tõhusamalt toime tulla ja teha algoritmid inimestega sarnasemaks.3,9,10

Inimestele on omane kalduvus antropomorfiseerida kolme peamise põhjuse tõttu:3

• Kognitiivsed vajadused – inimesed kasutavad olemasolevaid teadmisi, et mõista mitteinimlikke osalisi, eriti siis, kui need näitavad inimesega sarnaseid jooni (nt välimus, liikumine või käitumine).

• Sotsiaalsed vajadused, mis on seotud sotsiaalse läheduse otsinguga – eriti olukordades, kus suhtlus teiste inimestega on piiratud. Selle tulemusena tekivad emotsionaalsed sidemed näiteks lemmikloomade või elusana tajutavate esemetega.

• Turvatunde vajadus – ebakindlates olukordades püüavad inimesed suurendada oma arusaamist ja kontrolli ümbritseva keskkonna üle. Selleks omistavad nad elututele nähtustele – nagu tehnoloogilised süsteemid või loodusnähtused – inimlikke omadusi. See muudab keerulised nähtused arusaadavamaks ja ennustatavamaks, võimaldades tunda end turvalisemalt.

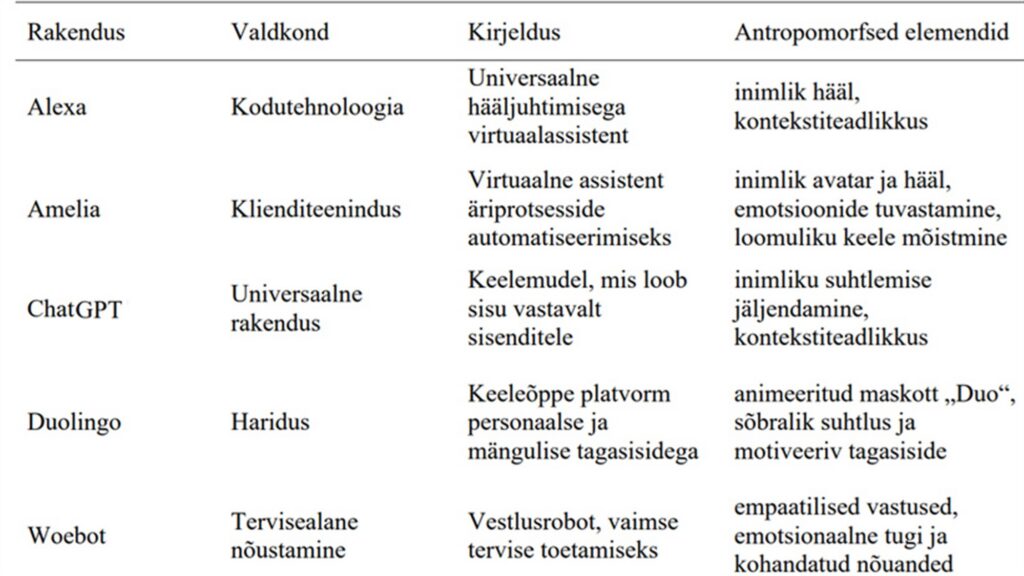

Antropomorfsed elemendid on inimlik keelekasutus, emotsioonide väljendamine, nimed jpm. Tabelis on esitatud näited sellistest TI-rakendustest, mis sisaldavad antropomorfseid elemente.

Tabel. Antropomorfsed elemendid TI-rakendustes

Valdavalt ollakse seisukohal, et tunnetatav inimlik aspekt mitte ainult ei paranda kasutajakogemust, vaid suurendab ka kasutajate pühendumust ja lojaalsust TI-süsteemidele. Siiski ei ole antropomorfiseerimine vaid toetava mõjuga, mitteinimlike osalejate ülemääraselt inimlikud omadused võivad tekitada ebamugavust, mida kirjeldatakse kui „õõvaorgu“ (ingl uncanny valley).11 See viitab nähtusele, kus inimsarnane robot, nukk või virtuaalne tegelane tekitab inimeses ebamugavust, kuna ta on liiga sarnane, ent mitte läbinisti inimlik – see „peaaegu inimene“ mõjub kummastavalt või lausa kõhedust tekitavalt. Kõik eespool toodud asjaolud suunavad analüüsima, kas inimlikustamise tunnuste lisamine mõjutab sõnumi tajumist.

Uuring inimlikustamise rollist TI-sõnumi tajumisel

Antropomorfistlik sõnum on mahukam kui neutraalne, sest materjalile tuleb lisada märke ja sõnu, mis seda kuvandit tekitavad. See on meie poolt järgnevalt käsitletava Eestis hiljuti tehtud uuringu ning antorpomorfistliku ja neutraalse materjali võrdlus tugineb metoodikal, mille ülesehitus ja andmete kogumise põhimõtted lähtuvad Schmallenbachi ja Wirthmanni (2024) käsitlusest,12 milles võrreldi TI-ga ja TI-ta koostatud sõnumeid. Eestis läbi viidud uuringu teema käsitles linnaruumi hoonete energiatõhusust ja osalejatele esitati tehisintellekti loodud lahendus probleemile – idee kas antropomorfsel või neutraalsel kujul. Osalejatel paluti ideed hinnata viiepunktilise Likerti skaalal kolme hindamiskriteeriumi lõikes: innovatiivsus, kasulikkus ja teostatavus. Uuringu sisu loomiseks kasutati ChatGPT-4o-d, milles koostati sobivad materjalid, tagades erinevuse antropomorfse ja neutraalse esitusviisi vahel. Antropomorfne ja neutraalne tekst erinesid 24 sõna (ca 19%) võrra, kusjuures antropomorfses materjalis kasutati rohkem määrsõnu, asesõnu, tegusõnu, sümboleid ja kirjamärke. Antropomorfse stiimuli eripäraks oli mina-vormi ja emotikoni lisamine sõnumile, mille sisu oli ühesugune. Vastajad teadsid, et nad hindavad tehisintellekti loodud materjali, siinkohal väljavõte instruktsioonist: „Allpool esitatud idee on tehisintellekti (ChatGPT) vastus keskkonnasäästu ja energiatõhususe probleemipüstitusele.“

Uuringus osales 125 vastajat vanusevahemikus 18–54 aastat. Valdav osa vastajatest (74,4%) olid bakalaureuse taseme üliõpilased. Vastajad jagati juhuslikult kahte gruppi: eksperimentaalgruppi (n = 64), kellele esitati idee inimlikustatud kujul ja kontrollgruppi (n = 61), kus sama idee olid esitatud ilma antropomorfsete elementideta. Osalejatelt küsiti ka täiendavat informatsiooni sotsiaal-demograafiliste tunnuste ning kogemuste ja hoiakute kohta.

TI kasutamise harjumus sõnumi tajumisel

Osalejate generatiivse tehisintellekti kasutamise harjumused viitasid sagedasele ja aktiivsele kokkupuutele tehnoloogiaga. 38,4% vastajatest kasutas generatiivset TI-d iga päev ning 44% mitu korda nädalas – peamiselt õppetegevuse ja akadeemiliste tööde toetamiseks, samuti isiklikes projektides ja töökohustuste täitmiseks. Kõige enam vastajaid (46,4%) kasutas TI-d keskmiselt 1–5 tundi nädalas, 8% 6–10 tundi ja 4,8% 11–20 tundi nädalas. Vähem kui ühe tunni nädalas kasutas generatiivset TI-d 36,8% vastajatest ning 4% ei kasutanud üldse.

Uuringust selgus, et vastajatel oli sotsiaal-emotsionaalne eeldus, et TI kasutamisel rakendatakse antropomorfitseerimist. Mõlemas vastajate grupis oli kahel väitel „TI-ga suheldes tajun seda pigem kellenagi kui millenagi“ ja „TI-ga suheldes tunnen selle vastu teatavat empaatiat“ tugev omavaheline seos.

Vastajad, kes hindasid inimlikustamise tunnustega vastust, pidasid lahendusi innovatiivsemaks, kui nad arvasid, et antropomorfsete tunnustega materjal on eetiline (väide: „inimesesarnase käitumise ja väljanägemisega TI on eetiliselt vastuvõetav“). Nende arvates on ka kasulikkus ja teostatavus seotud usaldusega ehk väitega „usaldan TI loodud vastuseid“.

Neutraalsemat vastust hinnanud kontrollgrupis oli lahenduse kasulikkuse hinnang TI inimlikkuse tajumisega hoopis negatiivselt seotud. Selle grupi hinnangute seosed peegeldavad ratsionaalseid valikumehhanisme ja negatiivseid kogemusi.

Üks mõtlemapanev seos ilmneb tajutud ärritusega („TI-ga suhtlemine tekitab minus vahetevahel frustratsiooni või ärritust“), mille seosed hinnangutega varieerusid sõltuvalt esitusviisist. Nimelt, idee neutraalse esitlusviisi korral tuvastati tõenäosus, et ärrituse suuremaks hindamise korral peeti kasulikkust väiksemaks. Antropomorfse esitluse korral oli see vastupidine.

Kui TI töö on esitatud inimesesarnaselt, ei tähenda frustratsioon tingimata kriitilist või madalat hinnangut. Selline tunne võib hoopis suunata vastajat ideesse rohkem süvenema ja sisulisemalt lähenema. Tulemus on kooskõlas Epley jt (2007) ning Waytzi jt (2010) mõjuvajaduse käsitlusega, mille kohaselt kiputakse ebakindlates või kontrolli vajavates olukordades omistama mitteinimlikele objektidele inimlikke tunnuseid, et muuta need arusaadavamaks ja prognoositavamaks. Hinnangu andmisel võib antropomorfne disain negatiivseid emotsioone osaliselt tasakaalustada.

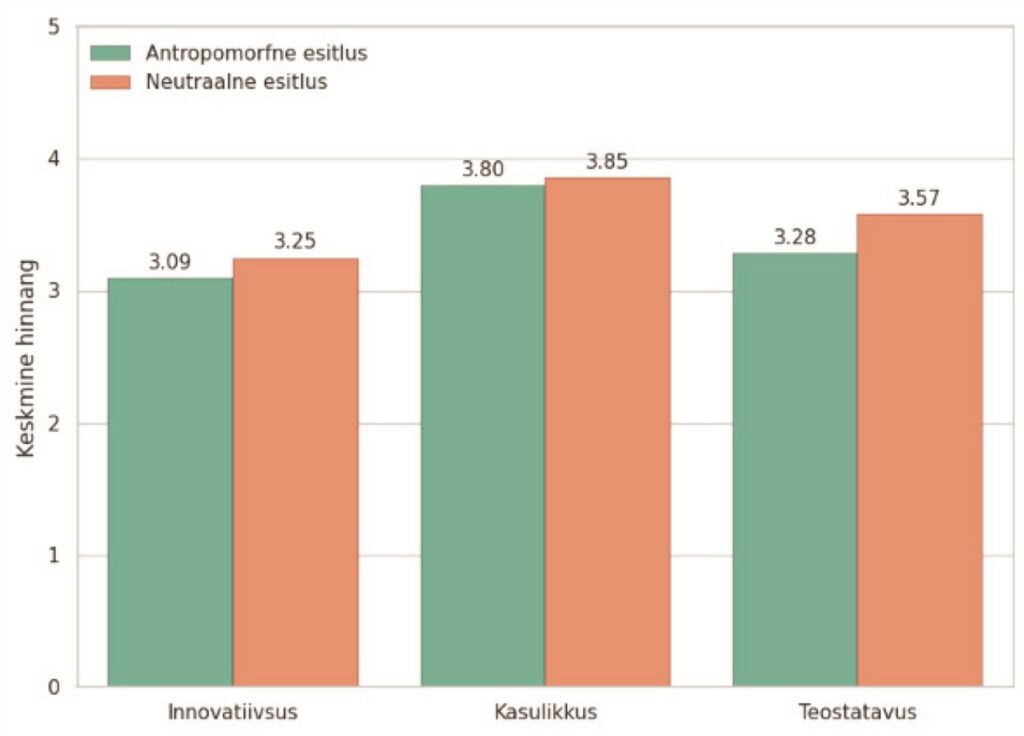

Hinnangud tehisintellekti ideele

Vastajate keskmised hinnangud ideele ei erinenud sõltuvalt sellest, kas esitus oli antropomorfne või neutraalne. Joonisel on esitatud vastajate keskmised hinnangud kolmele hindamiskriteeriumile mõjugrupis (antropomorfne esitus) ja kontrollgrupis (neutraalne esitus). Andmete analüüs näitab, et erinevused pole statistiliselt olulised ühegi võrdluskategooria osas, ehkki antropomorfsele ja neutraalsele materjalile antavad keskmised hinnangud on pisut erinevad.

Joonis. Antropomorfsele ja neutraalsele sõnumile antud hinnangute võrdlus

Kahe eristuva sõnumiga küsitlusandmete täpsem analüüs näitab, et vastajate sugu ega varasem kokkupuude generatiivse TI-ga ei seostunud statistiliselt olulisel määral hinnangutega ideede innovatiivsusele, kasulikkusele ega teostatavusele. Ülesandekeskses ja analüütilist hindamist eeldavas kontekstis ei kujunenud antropomorfne esitus osalejate jaoks tähenduslikumaks ega muutnud nende antud hinnanguid ideedele.

Peamiseks hinnanguid kujundavaks teguriks osutus usaldus tehisintellekti vastuste vastu – mida kõrgem oli usaldus, seda kõrgemad olid hinnangud kõigil hindamiskriteeriumidel. Kui kasutaja peab TI vastuseid usaldusväärseks, kujuneb tema hinnang kõrgemaks sõltumata sellest, kas idee on esitatud neutraalselt või antropomorfselt. Need tulemused on kooskõlas eelnevate uuringutega, mille kohaselt on usaldus tähtis eeltingimus TI-rakenduste edukaks kasutamiseks.5 Seega võib järeldada, et tugevalt väljakujunenud usaldus TI vastu muudab täiendavad antropomorfsed elemendid hinnangute seisukohalt ebaoluliseks. Sellest tulenevalt võiks usalduse tugevdamine olla prioriteet generatiivsete TI-süsteemide disainis või kasutuskogemuse kujundamisel enne, kui selleks rakendatakse keerukamaid antropomorfseid kujundusvõtteid.

Kokkuvõte

Tulles pealkirjas esitatud küsimuse juurde, saab vastata, et tehisintellekti kasutamisel on mitmeid võimalusi tegutseda loodust säästvamalt ja koostada vähema sõnade mahuga materjale, sest inimlikustamine ei pruugi igas olukorras lisaväärtust anda ja ressursisäästu kaalutlus tekib eeskätt faktipõhiste kasutusjuhtude puhul. Seal, kus kasutajakogemus ja usaldus on tähtsamad (nt virtuaalne tugi või kliendisuhtlus), võib väike lisatekst siiski ära tasuda. Ka varasem TI kasutamise kogemus ei olnud tähtis, kui mõlemad vastajate grupid hindasid ideede innovaatilisust, kasulikkust ja teostatavust. Pigem on TI kasutamisel tähtsaks teemaks usalduse olemasolu või puudumine ehk sügavalt tunnetatav sotsiaalsete ja turvavajaduste habras tasakaal. See on üks tehisintellekti rakendamise peaküsimusi.

Artikli materjalide ettevalmistamist on toetanud projekt MKM-Pol 15 „Tehnoloogiliste uuenduste mõjud tootlikkusele: ettevõtete juhtimisvõimekuse roll“.

1 Fabrizio Dell’Acqua et al., The cybernetic teammate: A field experiment on generative AI reshaping teamwork and expertise. NBER Working Paper No. 33641. National Bureau of Economic Research 2025.

2 Pranshu Verma, Shelly Tan, A bottle of water per email: the hidden environmental costs of using AI chatbots. – Washington Post 19. XI 2024.

3 Adam Waytz, Nicholas Epley, John T. Cacioppo, Social Cognition Unbound: Insights Into Anthropomorphism and Dehumanization. – Current Directions in Psychological Science 2010, 19(1).

4 Hasan Mahmud, A. K. M. Najmul Islam, Syed Ishtiaque Ahmed, Kari Smolander, What influences algorithmic decision-making? A systematic literature review on algorithm aversion. – Technological Forecasting and Social Change 2022, 175, 121390.

5 Berkeley J Dietvorst, Joseph P Simmons, Cade Massey, Algorithm aversion: people erroneously avoid algorithms after seeing them err. – Journal of Experimental Psychology General 2015, 144(1).

6 Ekaterina Jussupow, Izak Benbasat, Armin Heinzl, Why are we averse towards algorithms? A comprehensive literature review on algorithm aversion. In Proceedings of the 28th European Conference on Information Systems (ECIS), an online AIS conference 15.–17. VI 2020.

7 Amani Alabed, Ana Javornik, Diana Gregory-Smith, AI anthropomorphism and its effect on users’ self-congruence and self–AI integration: A theoretical framework and research agenda. – Technological Forecasting and Social Change 2022, 182, 121786.

8 Michal Kolomaznik, Vladimir Petrik, Michal Slama, Vojtech Jurik, The role of socio-emotional attributes in enhancing human-AI collaboration. – Frontiers in Psychology 2024, 15, 1369957.

9 Theo Araujo, Living up to the chatbot hype: The influence of anthropomorphic design cues and communicative agency framing on conversational agent and company perceptions. – Computers in Human Behavior 2018, 85.

10 Izak Benbasat, Angelika Dimoka, Paul A. Pavlou, Lingyun Qiu, The role of demographic similarit in people’s decision to interact with online anthropomorphic recommendation agents: Evidence from a functional magnetic resonance imaging (fMRI) study. – International Journal of Human-Computer Studies 2020, 133.

11 Õõvaoru hüpoteesi loojaks on jaapani robootik Masahiro Mori. Vt: Masahiro Mori, Karl F. MacDorman; Norri Kageki, The Uncanny Valley [From the Field]. – IEEE Robotics & Automation Magazine 2012, 19(2).

12 Leo Schmallenbach, Bastian Wirthmann, The evaluation of ideas generated by artificial intelligence [Conference paper]. DRUID24 Conference, Copenhagen 13.–15. VI 2024.